分布式事务问题

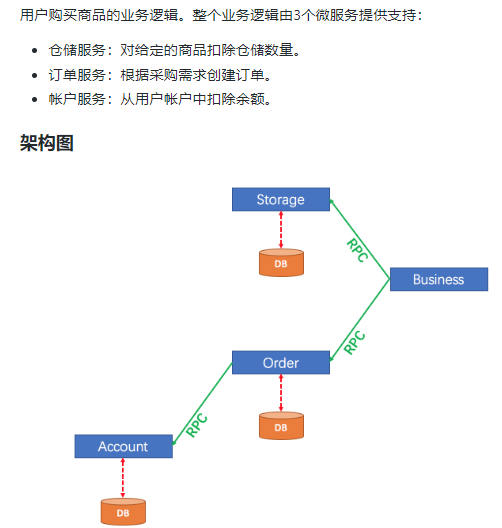

- 在分布式之前,一切组件都在一台机器上面。

- 在使用分布式之后,单体应用被拆分成微服务应用,原来的三个模块被拆分成三个独立的应用,分别使用三个独立的数据源。

- 业务操作需要调用三个服务来完成。此时每个服务内部的数据一致性由本地事务来保证,但是全局的数据一致性问题没法保证

一句话:一次业务操作需要跨多个数据源或需要跨多个系统进行远程调用,就会产生分布式事务问题

一、Seata简介与安装

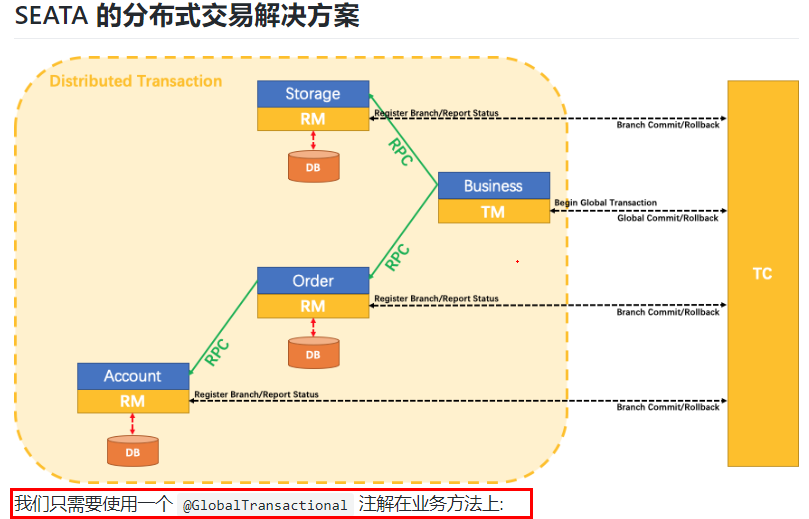

Seata是一款开源的分布式事务解决方案,致力于在微服务架构下提供高性能和简单易用的分布式事务服务

1.1相关术语

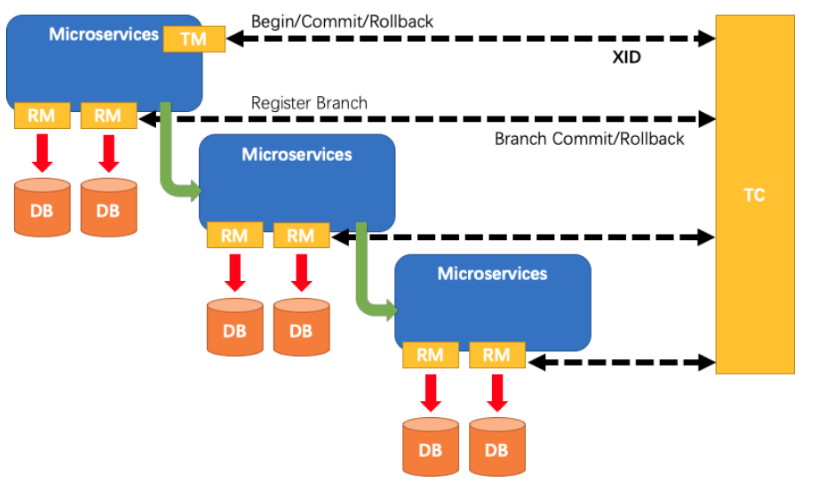

一个典型的分布式事务过程,可以用分布式处理过程的一ID+三组件模型来描述。

一ID(全局唯一的事务ID):Transaction ID XID,在这个事务ID下的所有事务会被统一控制

三组件:

4. Transaction Coordinator(TC):事务协调器,维护全局事务的运行状态,负责协调并驱动全局事务的提交或回滚:(Server端,位单独服务器部署)

5. Transaction Manager™ :事务管理器,控制全局事务的边界,负责开启一个全局事务,并最终发起全局提交或全局回滚的决议

6. Resource Management(RM):资源管理器,控制分支事务,负责分支注册,状态汇报,并接受事务协调器的指令,驱动分支事务的提交和回滚

7. Seata分TC、TM和RM三个角色,TC(Server端)为单独服务端部署,TM和RM(Client端)由业务系统集成(微服务)

官网地址:http://seata.io/zh-cn/

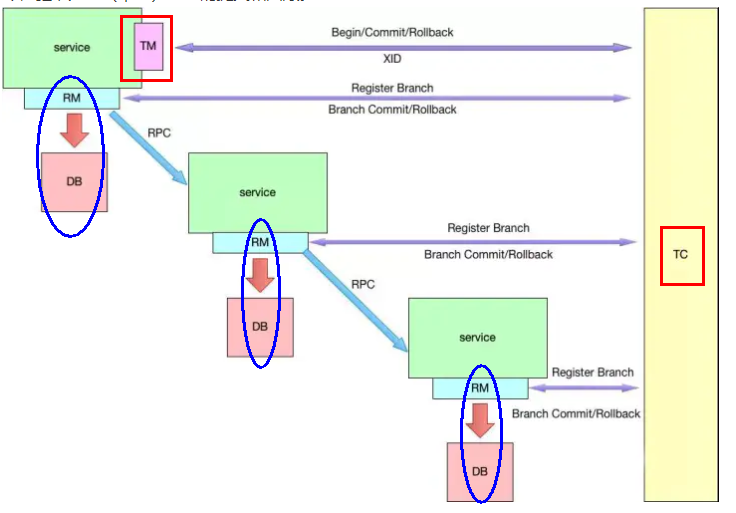

1.2典型分布式控制事务流程

- TM 向 TC 申请开启一个全局事务,全局事务创建成功并生成一个全局唯一的 XID;

- XID 在微服务调用链路的上下文中传播;(也就是在多个TM,RM中传播)

- RM 向 TC 注册分支事务,将其纳入 XID 对应全局事务的管辖;

- TM 向 TC 发起针对 XID 的全局提交或回滚决议;

- TC 调度 XID 下管辖的全部分支事务完成提交或回滚请求。

1.3 Seata-Server的下载与配置

老师采用的是0.9版本,我这里尝试的1.42版本,差别还是蛮大的

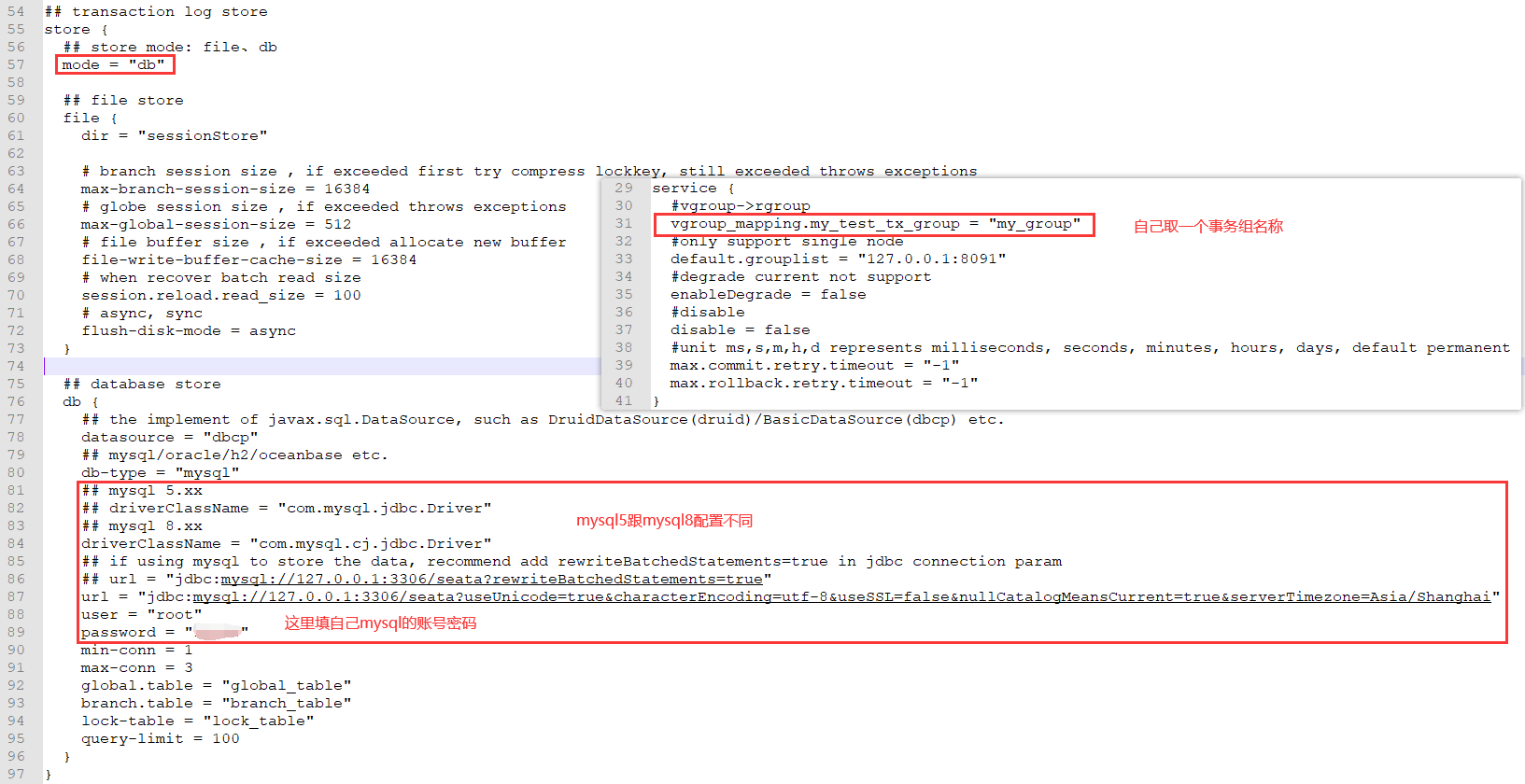

1.3.1修改file.conf文件

解压到指定目录并修改conf文件

1.备份原始的conf

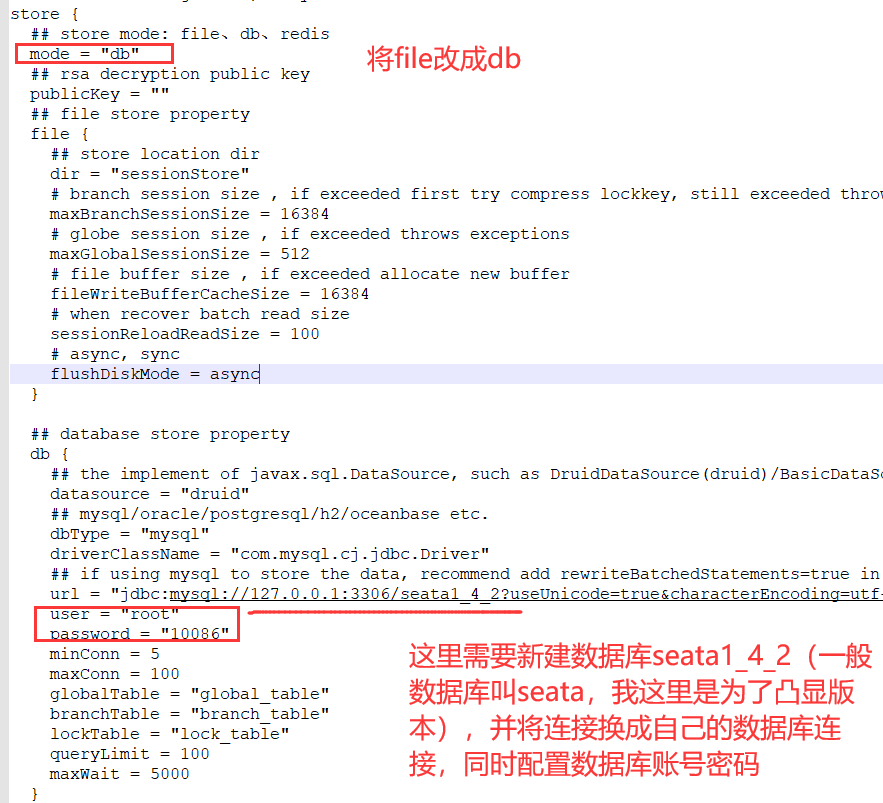

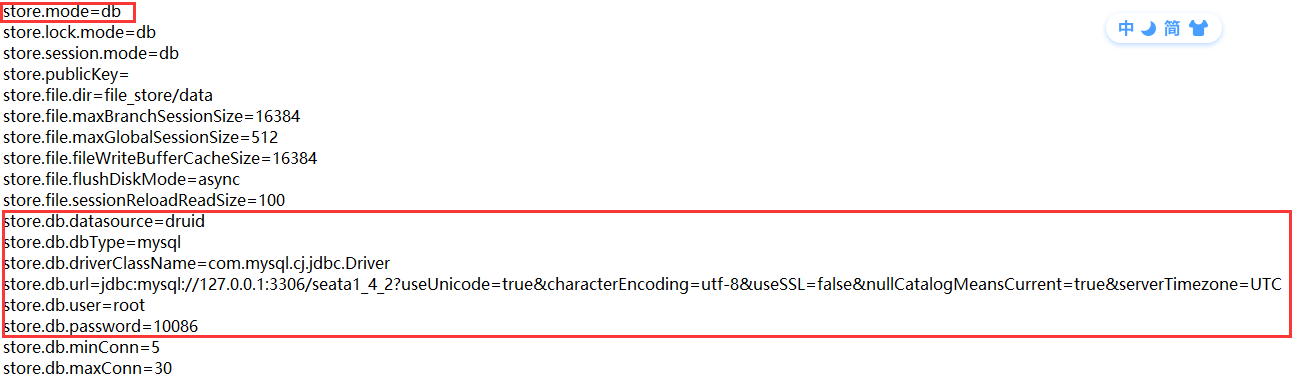

主要修改:自定义事务组名称+事务日志存储模式为db+数据库连接信息。

2. 修改file.conf文件

a. service模块(1.4.2里面没有这个模块,需要自己加)

b. store模块

这里采用mysql5.7以及seata1.4.2

## transaction log store, only used in seata-server

store {

## store mode: file、db、redis

mode = "db"

## rsa decryption public key

publicKey = ""

## file store property

file {

## store location dir

dir = "sessionStore"

# branch session size , if exceeded first try compress lockkey, still exceeded throws exceptions

maxBranchSessionSize = 16384

# globe session size , if exceeded throws exceptions

maxGlobalSessionSize = 512

# file buffer size , if exceeded allocate new buffer

fileWriteBufferCacheSize = 16384

# when recover batch read size

sessionReloadReadSize = 100

# async, sync

flushDiskMode = async

}

## database store property

db {

## the implement of javax.sql.DataSource, such as DruidDataSource(druid)/BasicDataSource(dbcp)/HikariDataSource(hikari) etc.

datasource = "druid"

## mysql/oracle/postgresql/h2/oceanbase etc.

dbType = "mysql"

## mysql 5.xx

## driverClassName = "com.mysql.jdbc.Driver"

## mysql 8.xx

driverClassName = "com.mysql.cj.jdbc.Driver"

## if using mysql to store the data, recommend add rewriteBatchedStatements=true in jdbc connection param

## url = "jdbc:mysql://127.0.0.1:3306/seata?rewriteBatchedStatements=true"

url = "jdbc:mysql://127.0.0.1:3306/seata?useUnicode=true&characterEncoding=utf-8&useSSL=false"

user = "root"

password = "10086"

minConn = 5

maxConn = 100

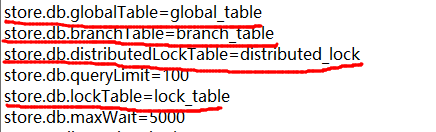

globalTable = "global_table"

branchTable = "branch_table"

lockTable = "lock_table"

queryLimit = 100

maxWait = 5000

}

## redis store property

redis {

## redis mode: single、sentinel

mode = "single"

## single mode property

single {

host = "127.0.0.1"

port = "6379"

}

## sentinel mode property

sentinel {

masterName = ""

## such as "10.28.235.65:26379,10.28.235.65:26380,10.28.235.65:26381"

sentinelHosts = ""

}

password = ""

database = "0"

minConn = 1

maxConn = 10

maxTotal = 100

queryLimit = 100

}

}

## 1.4.2 版本需要自己手动增加service模块

service {

#vgroup->rgroup

vgroup_mapping.my_test_tx_group = "my_group"

#only support single node

default.grouplist = "127.0.0.1:8091"

#degrade current not support

enableDegrade = false

#disable

disable = false

#unit ms,s,m,h,d represents milliseconds, seconds, minutes, hours, days, default permanent

max.commit.retry.timeout = "-1"

max.rollback.retry.timeout = "-1"

}

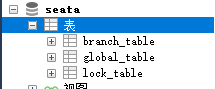

1.3.2数据库建表

数据库新建库seata,建表db_store.sql在\seata-server-0.9.0\seata\conf目录里面

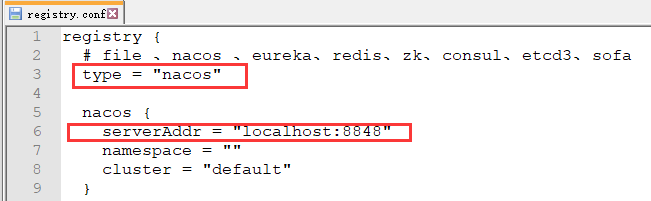

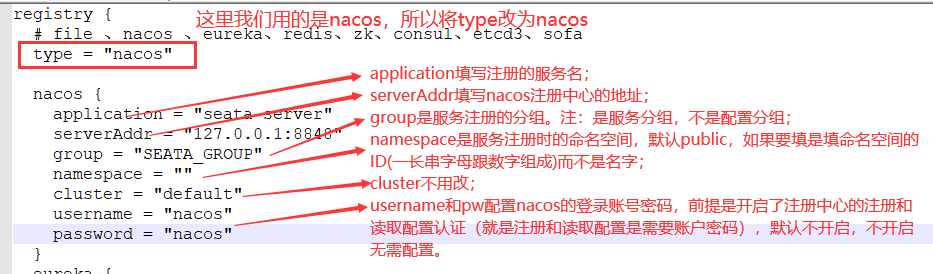

1.3.3修改seata-server-0.90\seata\conf目录下的registry.conf配置文件

- 目的是:指明注册中心为nacos,及修改nacos连接信息

1.3.4启动nacos和seata

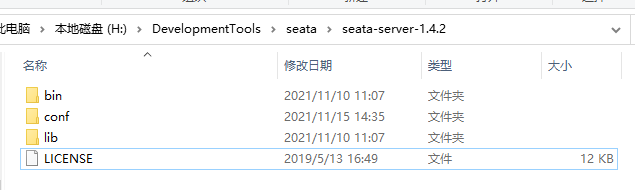

Seata 1.4.2版本填坑—nacos作为seata的注册/配置中心

Seata0.9.0版本不支持集群,生产环境下需要使用1.0.0以上版本。我们这里配置seata的最新版本1.4.2,下载后文件目录如下图所示:

0.启动nacos

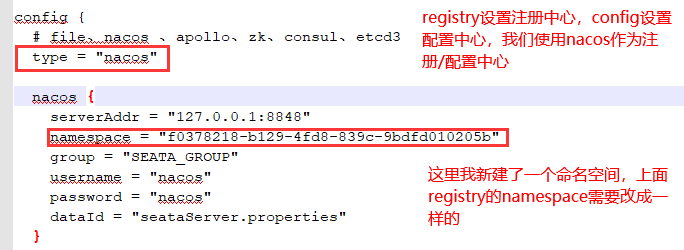

启动nacos,新建一个命名空间seata用于存放seata的配置信息。

注意这里的命名空间ID,后面会用到。这里不新建也可以,seata使用的是public。

我们使用nacos充当seata的注册中心和配置中心!

- 修改配置文件

①进入conf文件夹,修改file.conf文件

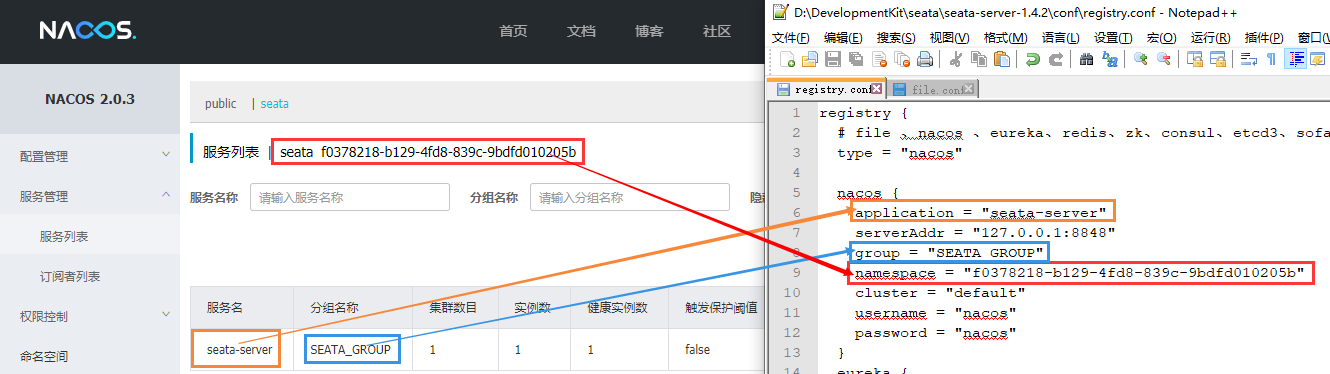

2.修改conf\registry.conf文件

思考:这里我们把seata-server端的config设置为了nacos,那么是不是第一步的file.conf文件就不再需要了。因为直接从nacos读取配置?

2.将配置导入nacos

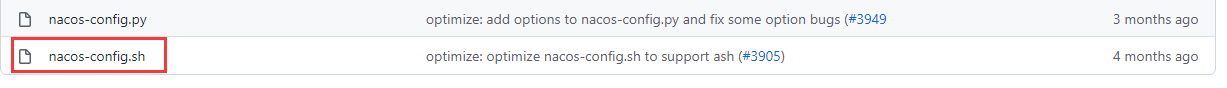

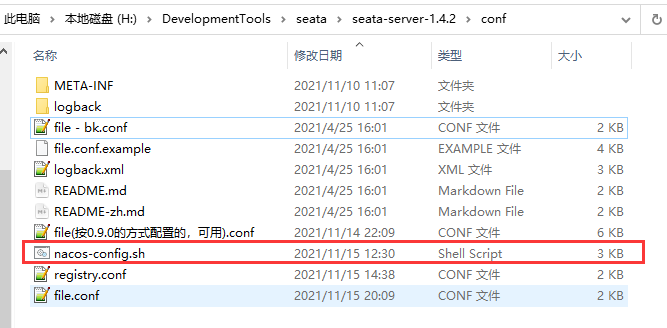

① 准备nacos-config.sh脚本

在conf文件夹下,需要有个nacos-config.sh文件,这个文件1.4.2版本没有。README-zh.md文件中访问config-center超链接

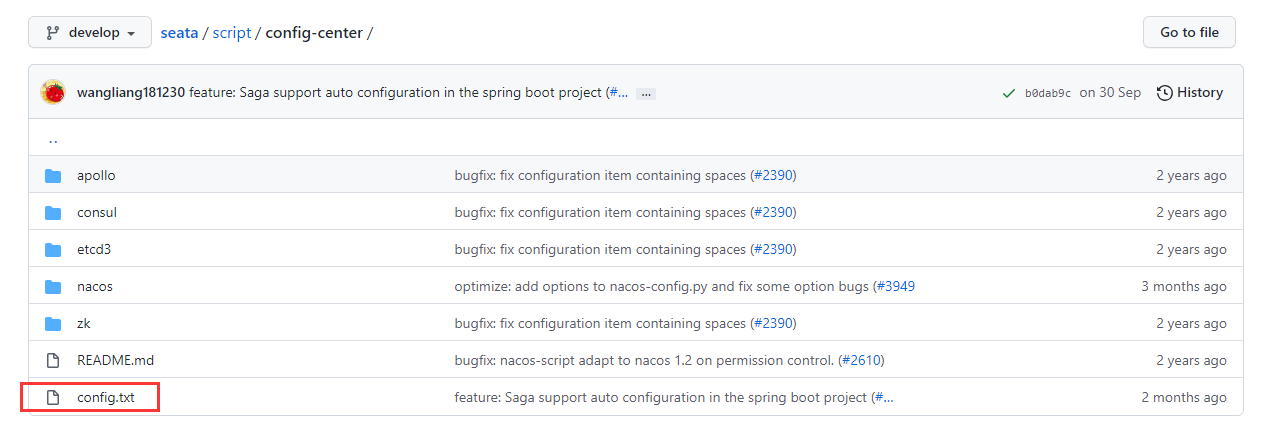

https://github.com/seata/seata/tree/develop/script/config-center,nacos文件夹下:

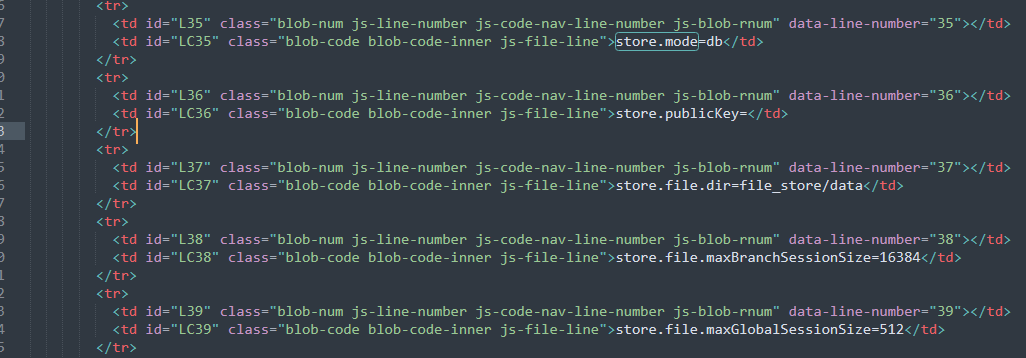

② config.txt准备及修改

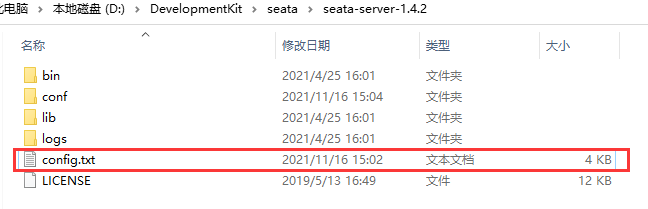

在conf目录下还需要一个config.txt文件,1.4.2版本同样没有,还是去README里面的config-center超链接。

config.txt需要放在conf的上级目录下。

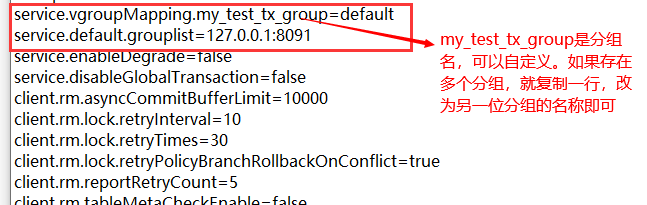

修改config.txt文件中的内容,主要是下面这几项:

改为使用db存储:

注意这里store.db.url中数据库的名字就是我们之后需要新建的数据库的名字。

1.4.2这里多了个distributedLockTable。

整个config.txt文件中,store.publicKey、store.redis.sentinel.masterName、store.redis.sentinel.sentinelHosts、store.redis.password四个属性默认都是空的。所以后面在将config.txt文件中的配置注册到nacos的时候,会出现四个失败项。

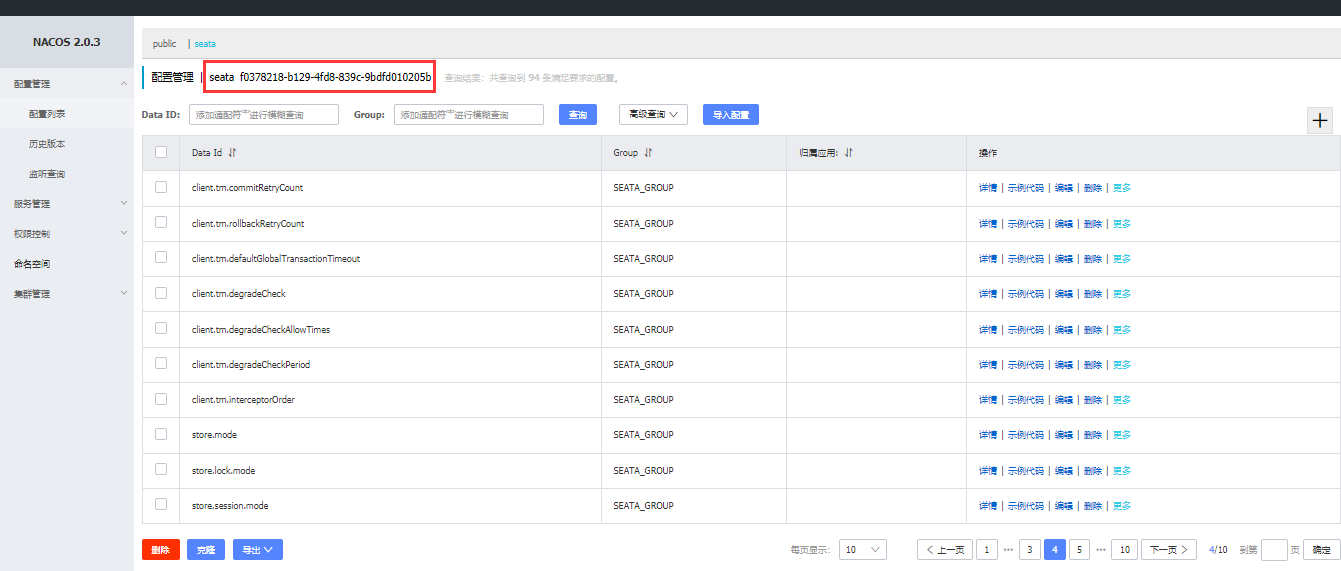

③ 导入seata相应的配置项到Nacos

config.txt就是seata各种详细的配置,执行nacos-config.sh即可将这些配置导入到nacos。这样就不需要将file.conf和registry.conf放到我们的项目中了,需要什么配置就直接从nacos中读取。(这句话是参考博客https://blog.csdn.net/jixieguang/article/details/110621561,我觉不完全对,后面registry.conf里的配置项虽然不需要.conf文件配置,但是需要在yml或properties文件中配置,而file.conf可以直接在nacos中读取)

然后再git bash界面输入:

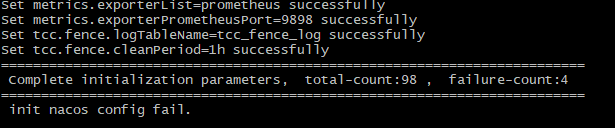

sh nacos-config.sh -h localhost -p 8848 -g SEATA_GROUP -t c69636a8-e9e8-4120-b395-8c0fe7d1fe8a -u nacos -w nacos

注:h表示nacos的地址,p表示端口号,g表示配置的分组,t表示命名空间的ID,u跟w表示nacos的账户密码。如果没有设置命名空间,而且都是默认选项直接 sh nacos-config.sh -h localhost就行。

可以看到共98项,导入失败4项,就是上面没有值的那四项(不影响,如果用到直接在nacos里面新建配置即可)

可以看到,nacos的seata命名空间中已经导入了配置项。(seata命名空间是我自己创建的,可以按自己的需求创建,不创建默认的就是public。)

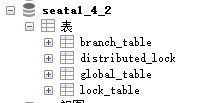

3. 数据库中建库建表

-- -------------------------------- The script used when storeMode is 'db' --------------------------------

-- the table to store GlobalSession data

CREATE TABLE IF NOT EXISTS `global_table`

(

`xid` VARCHAR(128) NOT NULL,

`transaction_id` BIGINT,

`status` TINYINT NOT NULL,

`application_id` VARCHAR(32),

`transaction_service_group` VARCHAR(32),

`transaction_name` VARCHAR(128),

`timeout` INT,

`begin_time` BIGINT,

`application_data` VARCHAR(2000),

`gmt_create` DATETIME,

`gmt_modified` DATETIME,

PRIMARY KEY (`xid`),

KEY `idx_gmt_modified_status` (`gmt_modified`, `status`),

KEY `idx_transaction_id` (`transaction_id`)

) ENGINE = InnoDB

DEFAULT CHARSET = utf8;

-- the table to store BranchSession data

CREATE TABLE IF NOT EXISTS `branch_table`

(

`branch_id` BIGINT NOT NULL,

`xid` VARCHAR(128) NOT NULL,

`transaction_id` BIGINT,

`resource_group_id` VARCHAR(32),

`resource_id` VARCHAR(256),

`branch_type` VARCHAR(8),

`status` TINYINT,

`client_id` VARCHAR(64),

`application_data` VARCHAR(2000),

`gmt_create` DATETIME(6),

`gmt_modified` DATETIME(6),

PRIMARY KEY (`branch_id`),

KEY `idx_xid` (`xid`)

) ENGINE = InnoDB

DEFAULT CHARSET = utf8;

-- the table to store lock data

CREATE TABLE IF NOT EXISTS `lock_table`

(

`row_key` VARCHAR(128) NOT NULL,

`xid` VARCHAR(128),

`transaction_id` BIGINT,

`branch_id` BIGINT NOT NULL,

`resource_id` VARCHAR(256),

`table_name` VARCHAR(32),

`pk` VARCHAR(36),

`gmt_create` DATETIME,

`gmt_modified` DATETIME,

PRIMARY KEY (`row_key`),

KEY `idx_branch_id` (`branch_id`)

) ENGINE = InnoDB

DEFAULT CHARSET = utf8;

CREATE TABLE IF NOT EXISTS `distributed_lock`

(

`lock_key` CHAR(20) NOT NULL,

`lock_value` VARCHAR(20) NOT NULL,

`expire` BIGINT,

primary key (`lock_key`)

) ENGINE = InnoDB

DEFAULT CHARSET = utf8mb4;

INSERT INTO `distributed_lock` (lock_key, lock_value, expire) VALUES ('AsyncCommitting', ' ', 0);

INSERT INTO `distributed_lock` (lock_key, lock_value, expire) VALUES ('RetryCommitting', ' ', 0);

INSERT INTO `distributed_lock` (lock_key, lock_value, expire) VALUES ('RetryRollbacking', ' ', 0);

INSERT INTO `distributed_lock` (lock_key, lock_value, expire) VALUES ('TxTimeoutCheck', ' ', 0);

这四个是和config.txt文件中的配置相对应的

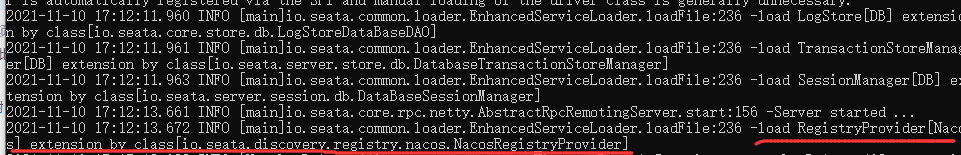

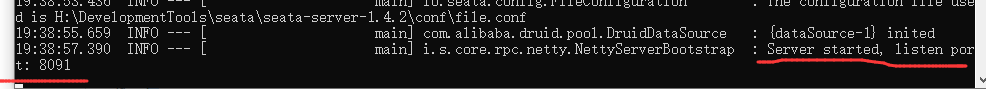

4. 启动seata

运行bin目录下的seata-server.bat。

出现下面字段表示seata启动成功。seata启动日志在C:\Users\admin\logs\seata文件夹下。

nacos中在seata命名空间内也成功注册,注意这里服务名对应的是registry.conf文件中nacos下面application的值。0.9.0版本好像设置不了这个,默认是serverAddr。

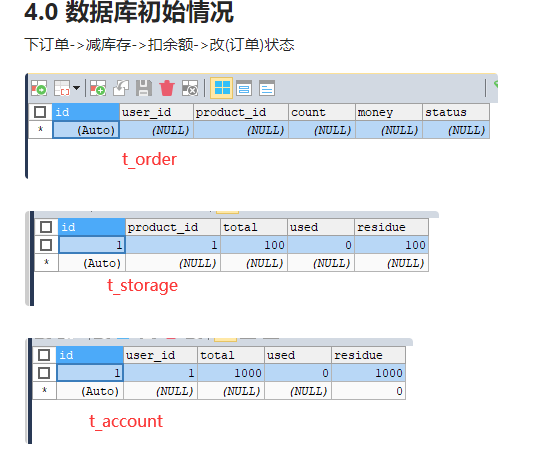

二、订单、库存、账户业务数据库准备

以下演示都需要先启动Nacos后启动Seata,保证两个都OK。Seata没启动报错no available server to connect。

2.1 分布式事务业务说明

这里我们会创建三个服务,一个订单服务,一个库存服务,一个账户服务。

当用户下单时,会在订单服务中创建一个订单,然后通过远程调用库存服务来扣减下单商品的库存,再通过远程调用账户服务来扣减用户账户里面的余额,最后在订单服务中修改订单状态为已完成。

该操作跨越三个数据库,有两次远程调用,很明显会有分布式事务问题。

下订单—>扣库存—>减账户(余额)

2.2创建业务数据库与表

1.创建业务数据库

这里都是基于官网的quick start

● seata_order:存储订单的数据库;

● seata_storage:存储库存的数据库;

● seata_account:存储账户信息的数据库

CREATE DATABASE seata_order;

CREATE DATABASE seata_storage;

CREATE DATABASE seata_account;

2.按照上述3库分别创建对应的业务表

seata_order库下建t_order表:

CREATE TABLE seata_order.`t_order` (

`id` BIGINT(11) NOT NULL AUTO_INCREMENT PRIMARY KEY,

`user_id` BIGINT(11) DEFAULT NULL COMMENT '用户id',

`product_id` BIGINT(11) DEFAULT NULL COMMENT '产品id',

`count` INT(11) DEFAULT NULL COMMENT '数量',

`money` DECIMAL(11,0) DEFAULT NULL COMMENT '金额',

`status` INT(1) DEFAULT NULL COMMENT '订单状态:0:创建中;1:已完结'

) ENGINE=INNODB AUTO_INCREMENT=7 DEFAULT CHARSET=utf8;

seata_storage库下建t_storage 表:

CREATE TABLE `seata_storage`.`t_storage` (

`id` BIGINT(11) NOT NULL AUTO_INCREMENT PRIMARY KEY,

`product_id` BIGINT(11) DEFAULT NULL COMMENT '产品id',

`total` INT(11) DEFAULT NULL COMMENT '总库存',

`used` INT(11) DEFAULT NULL COMMENT '已用库存',

`residue` INT(11) DEFAULT NULL COMMENT '剩余库存'

) ENGINE=INNODB AUTO_INCREMENT=2 DEFAULT CHARSET=utf8;

INSERT INTO seata_storage.t_storage(`id`, `product_id`, `total`, `used`, `residue`)

VALUES ('1', '1', '100', '0', '100');

seata_account库下建t_account 表:

CREATE TABLE `seata_account`.t_account (

`id` BIGINT(11) NOT NULL AUTO_INCREMENT PRIMARY KEY COMMENT 'id',

`user_id` BIGINT(11) DEFAULT NULL COMMENT '用户id',

`total` DECIMAL(10,0) DEFAULT NULL COMMENT '总额度',

`used` DECIMAL(10,0) DEFAULT NULL COMMENT '已用余额',

`residue` DECIMAL(10,0) DEFAULT '0' COMMENT '剩余可用额度'

) ENGINE=INNODB AUTO_INCREMENT=2 DEFAULT CHARSET=utf8;

INSERT INTO seata_account.t_account(`id`, `user_id`, `total`, `used`, `residue`) VALUES ('1', '1', '1000', '0', '1000');

3.按照上述3库分别创建对应的回滚日志表

订单-库存-账户3个库下都需要建各自的回滚日志表,\seata-server-0.9.0\seata\conf目录下的db_undo_log.sql;1.4.2版本的在README_ZH文件中的client:

# 0.9.0 版本

DROP TABLE IF EXISTS `undo_log`;

CREATE TABLE `undo_log` (

`id` BIGINT(20) NOT NULL AUTO_INCREMENT,

`branch_id` BIGINT(20) NOT NULL,

`xid` VARCHAR(100) NOT NULL,

`context` VARCHAR(128) NOT NULL,

`rollback_info` LONGBLOB NOT NULL,

`log_status` INT(11) NOT NULL,

`log_created` DATETIME NOT NULL,

`log_modified` DATETIME NOT NULL,

`ext` VARCHAR(100) DEFAULT NULL,

PRIMARY KEY (`id`),

UNIQUE KEY `ux_undo_log` (`xid`,`branch_id`)

) ENGINE=INNODB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8;

# 1.4.2版本

DROP TABLE IF EXISTS `undo_log`;

CREATE TABLE IF NOT EXISTS `undo_log`

(

`branch_id` BIGINT NOT NULL COMMENT 'branch transaction id',

`xid` VARCHAR(128) NOT NULL COMMENT 'global transaction id',

`context` VARCHAR(128) NOT NULL COMMENT 'undo_log context,such as serialization',

`rollback_info` LONGBLOB NOT NULL COMMENT 'rollback info',

`log_status` INT(11) NOT NULL COMMENT '0:normal status,1:defense status',

`log_created` DATETIME(6) NOT NULL COMMENT 'create datetime',

`log_modified` DATETIME(6) NOT NULL COMMENT 'modify datetime',

UNIQUE KEY `ux_undo_log` (`xid`, `branch_id`)

) ENGINE = InnoDB

AUTO_INCREMENT = 1

DEFAULT CHARSET = utf8 COMMENT ='AT transaction mode undo table';

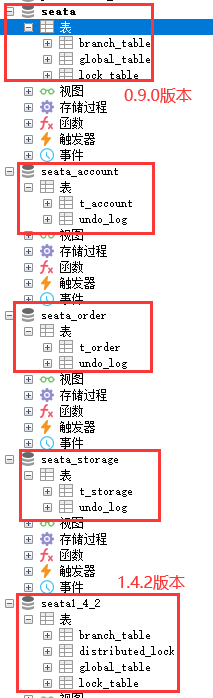

最终效果: 这里展示了1.4.2版本跟0.9版本,实际中用一个就行,别的版本一样。

三、订单、库存、账户业务微服务准备

业务需求:下订单->减库存-》扣余额->改订单状态

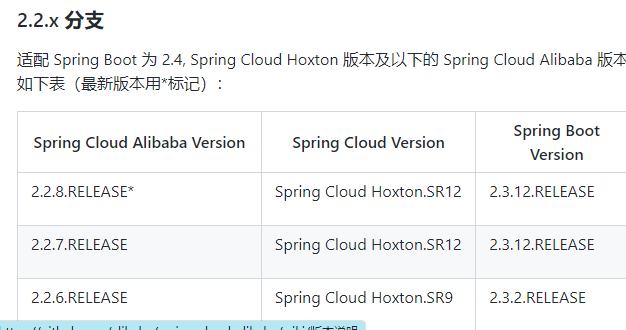

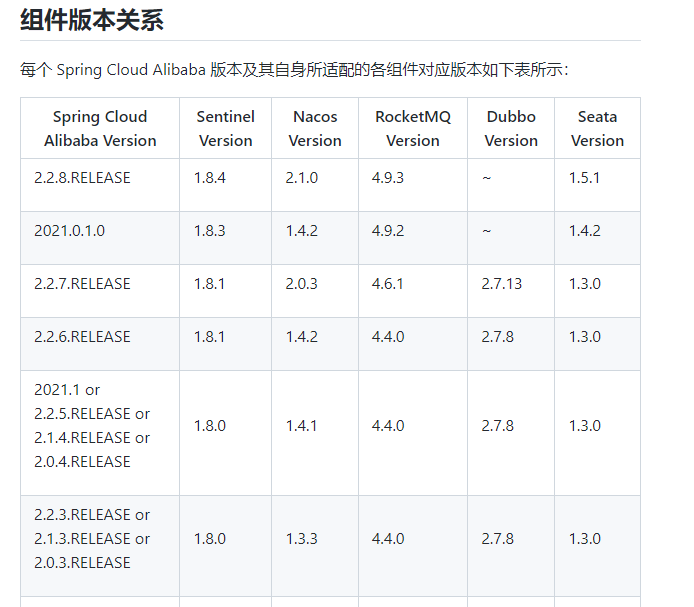

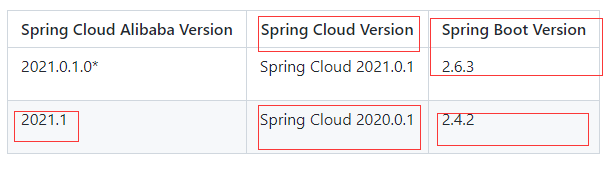

- 在这之前我们需要查下版本关系

版本对应关系

第一种老师版本:seata0.9.0 + nacos 1.1.4 + sentinel 1.7.0 + SpringCloud Alibaba 2.1.1RELEASE)前面用的各组件版本得对应上(头疼)

高版本seata1.4.2client配置

使用seata1.4.2 各个微服务整体上的代码是差不多的,区别的地方在于1.4.2支持yml、properties文件里配置client端的seata,不再需要file.conf/registry.conf文件。同时支持@EnableAutoDataSourceProxy注解开启数据源的自动代理(不需要手动配置数据源)

1.修改父工程版本控制

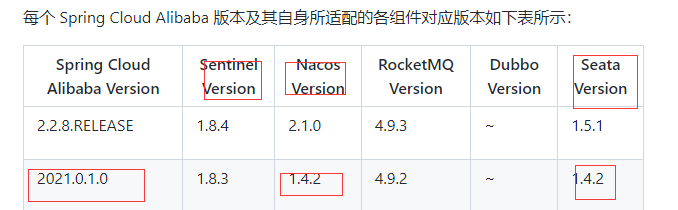

== 选择springcloud2020.0.1 springcloud-alibaba2021.0.1.0 springboot 2.4.2 sentinel 1.8.5 nacos1.4.2 seata1.4.2==

或者:

使用SpringCloud Hoxton.SR9+SpringCloud Alibaba 2.2.6.RELEASE+Spring Boot 2.3.2RELEASE+Nacos 1.4.2(我用的2.0.3)+Seata 1.3.0(我用的1.4.2)。

修改父工程的依赖版本,主要是让springboot、SpringCloud、SpringCloud alibaba版本对应。

<!--spring boot 2.3.2-->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-dependencies</artifactId>

<version>2.3.2.RELEASE</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<!--spring cloud Hoxton.SR9-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-dependencies</artifactId>

<version>Hoxton.SR9</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<!--spring cloud alibaba 2.2.6.RELEASE-->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-alibaba-dependencies</artifactId>

<version>2.2.6.RELEASE</version>

<type>pom</type>

<scope>import</scope>

</dependency>

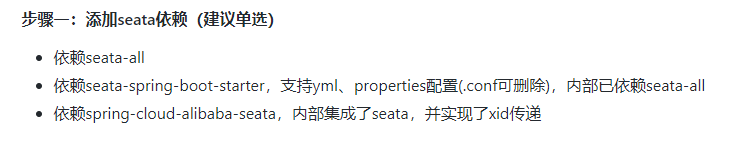

② 修改微服务模块seata依赖pom

官网上对seata依赖是这么描述的:

官网推荐依赖配置方式:

但是经过我测试发现,还是需要排除掉spring-cloud-starter-alibaba-seata里面的seata-all

<!--seata-->

<!--seata-spring-boot-starter 集成了seata-all,版本对应-->

<dependency>

<groupId>io.seata</groupId>

<artifactId>seata-spring-boot-starter</artifactId>

<version>1.4.2</version>

</dependency>

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-seata</artifactId>

<!-- 因为兼容版本问题,所以需要剔除它自带的seata的包 -->

<exclusions>

<exclusion>

<artifactId>seata-all</artifactId>

<groupId>io.seata</groupId>

</exclusion>

<exclusion>

<groupId>io.seata</groupId>

<artifactId>seata-spring-boot-starter</artifactId>

</exclusion>

</exclusions>

</dependency>

实际上我有微服务只配置了seata-spring-boot-starter依赖,spring-cloud-starter-alibaba-seata没有配置,并不影响正常使用。

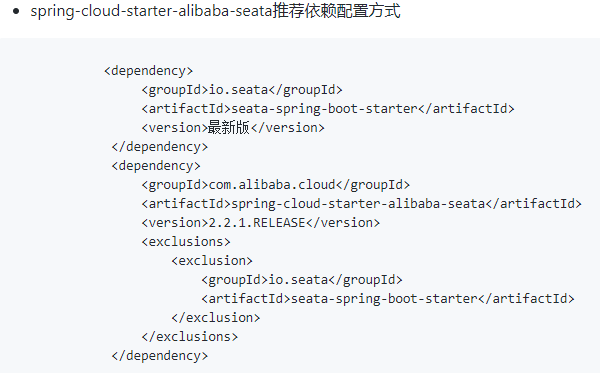

③ 修改微服务application.yml

直接将seata的相关配置,配置到application.yml文件中,几个微服务的yml类似:

# 这一块是配置seata的

seata:

enabled: true

application-id: ${spring.application.name}

enable-auto-data-source-proxy: true #是否开启数据源自动代理,默认为true

tx-service-group: my_test_tx_group #要与config.txt配置文件中的vgroupMapping一致

registry: #registry根据seata服务端的registry配置

type: nacos #默认为file

nacos:

application: seata-server #配置自己的seata服务,与registry.conf一致

server-addr: 127.0.0.1:8848 #根据自己的seata服务配置

username: nacos #根据自己的seata服务配置

password: nacos #根据自己的seata服务配置

namespace: f0378218-b129-4fd8-839c-9bdfd010205b #根据自己的seata服务配置

cluster: default # 配置自己的seata服务cluster, 默认为 default

group: "SEATA_GROUP" #根据自己的seata服务配置

config:

type: nacos #配置中心设置为nacos,直接从nacos上获取配置

nacos:

server-addr: 127.0.0.1:8848 #配置自己的nacos地址

group: SEATA_GROUP #配置自己的group,这里我配置跟registry.conf一样

username: nacos #配置自己的username

password: nacos #配置自己的password

namespace: f0378218-b129-4fd8-839c-9bdfd010205b #根据自己的seata服务配置

# dataId如果不用,就不需要配置

# dataId: seataServer.properties #配置自己的dataId,由于搭建服务端时把客户端的配置也写在了seataServer.properties,所以这里用了和服务端一样的配置文件,实际客户端和服务端的配置文件分离出来更好

# 这里是配置微服务的端口、注册到哪、数据源等等

server:

port: 2001

spring:

application:

name: seata-order-service

cloud:

# alibaba:

# seata:

# #自定义事务组名称需要与seata-server中file.conf中配置的事务组ID对应

# #vgroup_mapping.my_test_tx_group = "my_group"

# tx-service-group: my_group

nacos:

discovery:

server-addr: localhost:8848

datasource:

driver-class-name: com.mysql.cj.jdbc.Driver

url: jdbc:mysql://localhost:3306/seata_order?useUnicode=true&characterEncoding=UTF-8&useSSL=false

username:

password:

feign:

hystrix:

enabled: false

logging:

level:

io:

seata: info

mybatis:

mapperLocations: classpath:mapper/*.xml

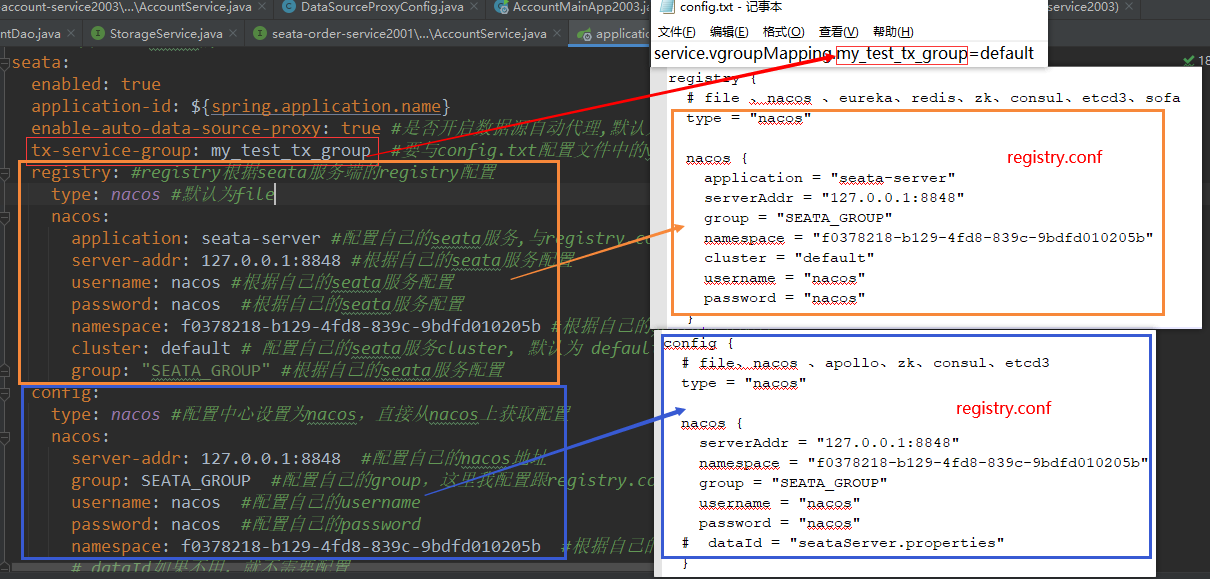

④ 修改主启动类和DataSourceProxyConfig类

主启动类

主启动类加上@EnableAutoDataSourceProxy注解,这里以storage的微服务为例:

package com.atguigu.cloudalibaba;

import io.seata.spring.annotation.datasource.EnableAutoDataSourceProxy;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.boot.autoconfigure.jdbc.DataSourceAutoConfiguration;

import org.springframework.cloud.client.discovery.EnableDiscoveryClient;

import org.springframework.cloud.openfeign.EnableFeignClients;

@SpringBootApplication(exclude = DataSourceAutoConfiguration.class)

@EnableDiscoveryClient

@EnableFeignClients

@EnableAutoDataSourceProxy

public class StorageMainApp2002 {

public static void main(String[] args) {

SpringApplication.run(StorageMainApp2002.class, args);

}

}

配置类

使用@EnableAutoDataSourceProxy注解后,不再需要DataSourceProxyConfig配置数据源代理。强行写会报错。如果需要自己配置数据源代理的话,在application.yml中设置seata.enable-auto-data-source-proxy为false,主启动类上去掉@EnableAutoDataSourceProxy注解即可。

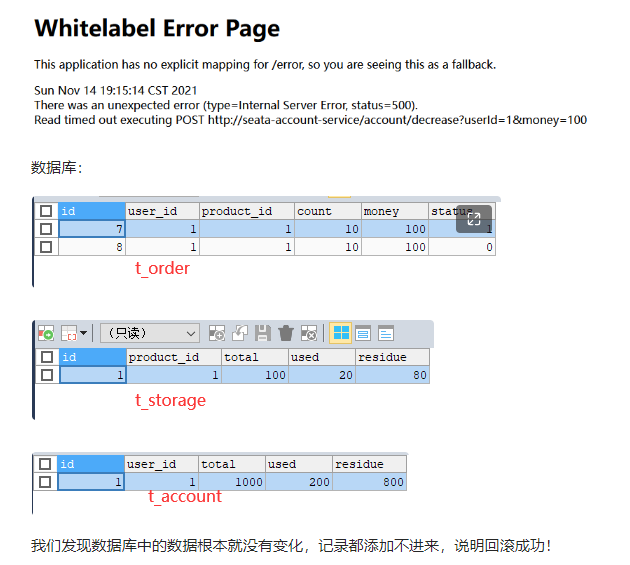

四、测试

Seata全局事务怎么使用

Spring提供的本地事务:@Transactional

Seata提供的全局事务:@GlobalTransactional

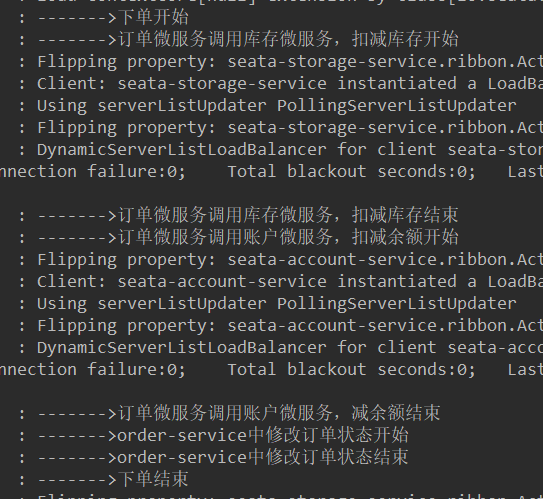

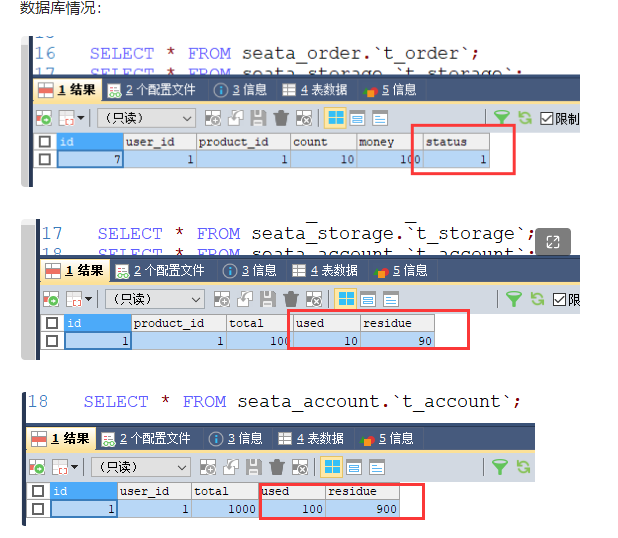

4.1 测试正常下单

启动nacos、seata、2001、2002、2003;

测试:http://localhost:2001/order/create?userId=1&productId=1&count=10&money=100

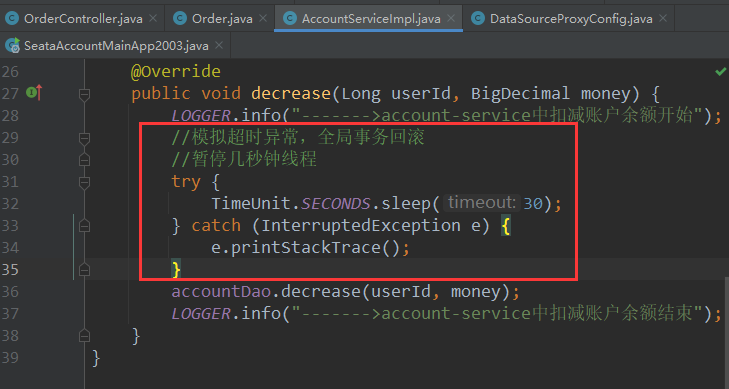

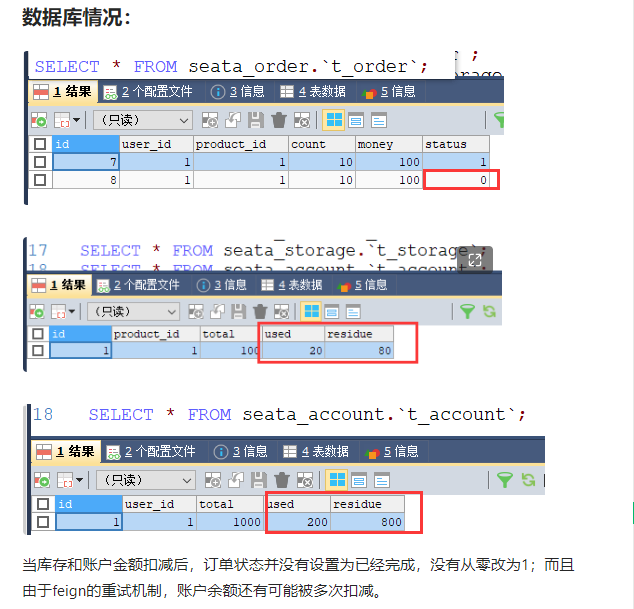

4.2 测试超时异常:不加**@GlobalTransactional

AccountServiceImpl添加超时:**

我们使用的是Openfeign,默认超时时长是1s,这里我们延迟30s。

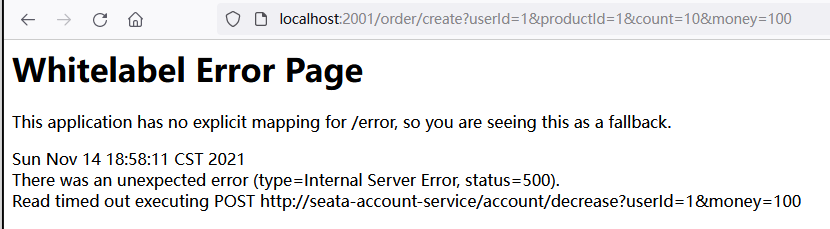

报错超时异常:

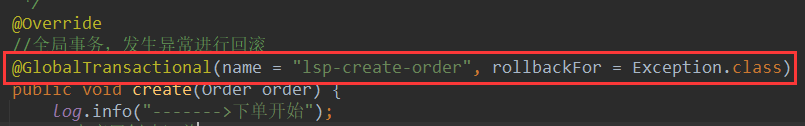

4.3 测试超时异常:加@GlobalTransactional

OrderServiceImpl添加@GlobalTransactional注解,注意改注解只能用在方法上!

name:给定全局事务实例的名称,随便取,唯一即可

rollbackFor:当发生什么样的异常时,进行回滚

noRollbackFor:发生什么样的异常不进行回滚。

package com.atguigu.cloudalibaba.service.Impl;

import com.atguigu.cloudalibaba.dao.OrderDao;

import com.atguigu.cloudalibaba.domain.Order;

import com.atguigu.cloudalibaba.service.AccountService;

import com.atguigu.cloudalibaba.service.OrderService;

import com.atguigu.cloudalibaba.service.StorageService;

import io.seata.spring.annotation.GlobalTransactional;

import lombok.extern.slf4j.Slf4j;

import org.springframework.stereotype.Service;

import javax.annotation.Resource;

@Service

@Slf4j

public class OrderServiceImpl implements OrderService {

@Resource

private OrderDao orderDao;

@Resource

private StorageService storageService;

@Resource

private AccountService accountService;

/**

* 创建订单->调用库存服务扣减库存->调用账户服务扣减账户余额->修改订单状态

* 简单说:

* 下订单->减库存->减余额->改状态

*/

@Override

//全局事务,发生异常进行回滚

@GlobalTransactional(name = "lsp-create-order", rollbackFor = Exception.class)

public void create(Order order) {

log.info("------->下单开始");

//本应用创建订单

orderDao.create(order);

//远程调用库存服务扣减库存

log.info("------->订单微服务调用库存微服务,扣减库存开始");

storageService.decrease(order.getProductId(),order.getCount());

log.info("------->订单微服务调用库存微服务,扣减库存结束");

//远程调用账户服务扣减余额

log.info("------->订单微服务调用账户微服务,扣减余额开始");

accountService.decrease(order.getUserId(),order.getMoney());

log.info("------->订单微服务调用账户微服务,减余额结束");

//修改订单状态为已完成

log.info("------->order-service中修改订单状态开始");

// 这里的话是不是应该是orderId?

orderDao.update(order.getUserId(),0);

log.info("------->order-service中修改订单状态结束");

log.info("------->下单结束");

}

}

4.4 小结

做好配置后,我们只需要使用一个 @GlobalTransactional(name = “lsp-create-order”, rollbackFor = Exception.class) 放在业务的入口,即可实现控制全局的事务。注意该注解只能放在方法上。

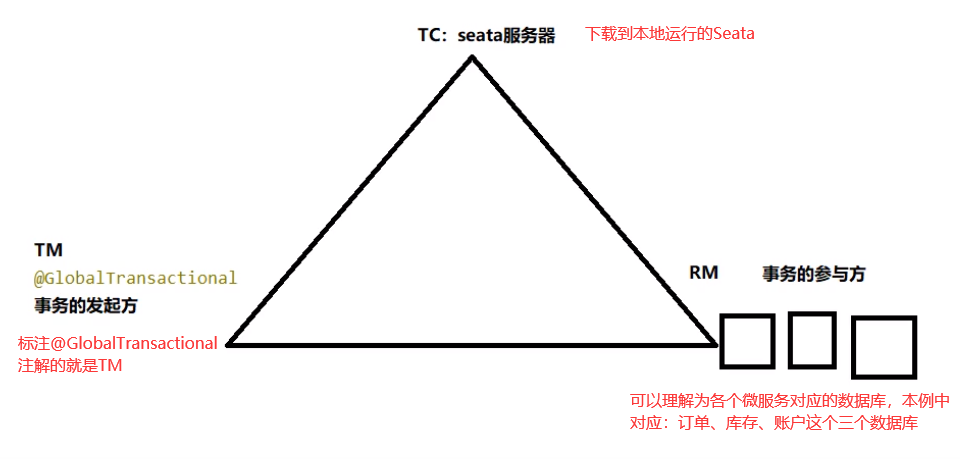

五、补充说明

TC:seata服务器; (我们电脑上启动的seata )

TM:事物的发起者,业务的入口。 哪个微服务使用了@GlobalTransactional哪个就是TM

RM:事务的参与者,一个数据库就是一个RM。

分布式事务的执行流程:

- TM 开启分布式事务(TM 向 TC 注册全局事务记录);

- 按业务场景,编排数据库、服务等事务内资源(RM 向 TC 汇报资源准备状态 );

- TM 结束分布式事务,事务一阶段结束(TM 通知 TC 提交/回滚分布式事务);

- TC 汇总事务信息,决定分布式事务是提交还是回滚;

- TC 通知所有 RM 提交/回滚 资源,事务二阶段结束。

5.2 AT模式(默认)如何做到对业务的无侵入

Seata有四大模式:AT(默认)、TCC、SAGA、XA。(阿里云上的AT叫做GTS,收费)

AT模式

AT模式两阶段提交协议的演变:

● 一阶段:业务数据和回滚日志记录在同一个本地事务中提交,释放本地锁和连接资源。

● 二阶段:

○ 提交异步化,非常快速地完成。

○ 回滚通过一阶段的回滚日志进行反向补偿(前面insert,后面回滚时就delete)。

每个数据库除了自身存储数据的表以外,都会有一个事务回滚表:undo_log

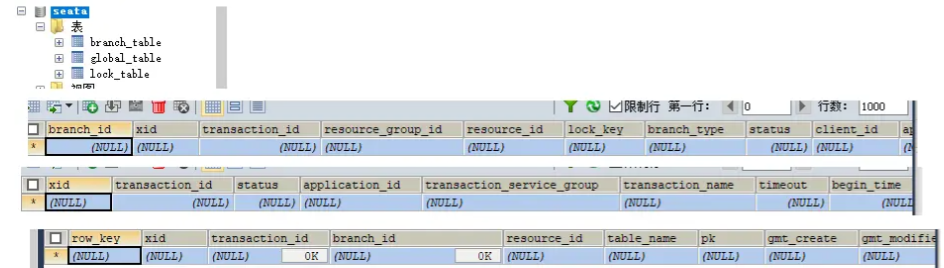

Seata库中存在:branch_table\global_table\lock_table\distributed_lock(高版本才有)这样一些表

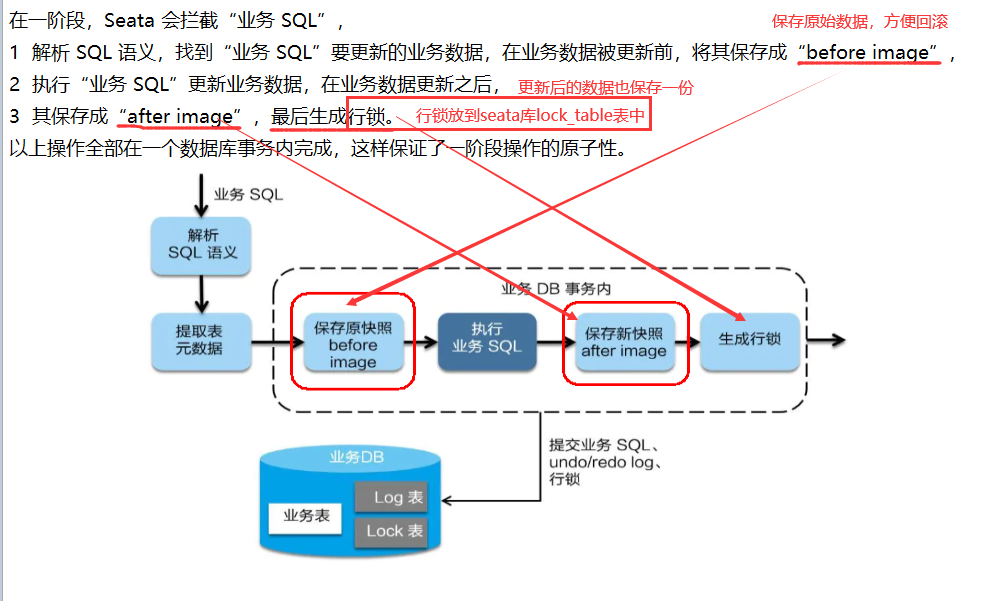

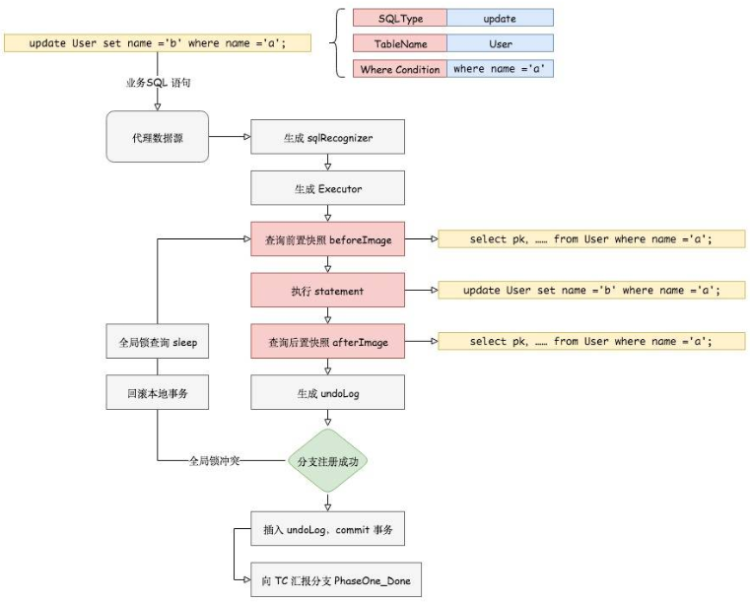

5.2.1一阶段的加载

在一阶段,Seata 会拦截“业务 SQL”,

1 解析 SQL 语义,找到“业务 SQL”要更新的业务数据,在业务数据被更新前,将其保存成“before image”(前置镜像)

2 执行“业务 SQL”更新业务数据,在业务数据更新之后,

3 其保存成“after image”,最后生成行锁。

以上操作全部在一个数据库事务内完成,这样保证了一阶段操作的原子性。

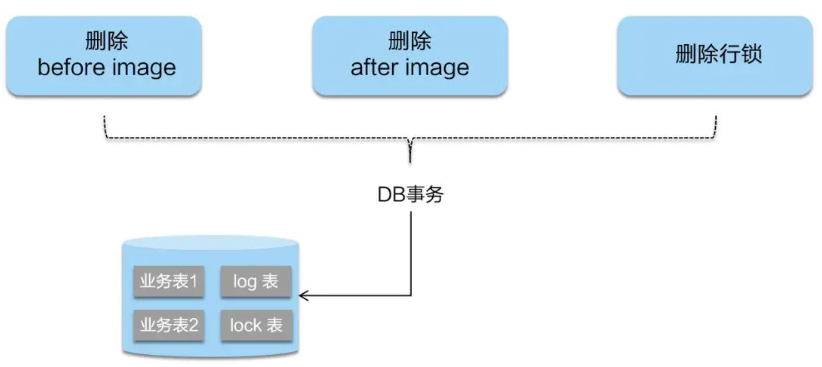

5.2.2 二阶段提交

因为“业务 SQL”在一阶段已经提交至数据库,二阶段如果顺利提交的话,那么Seata框架只需将一阶段保存的快照数据和行锁删掉,完成数据清理即可。

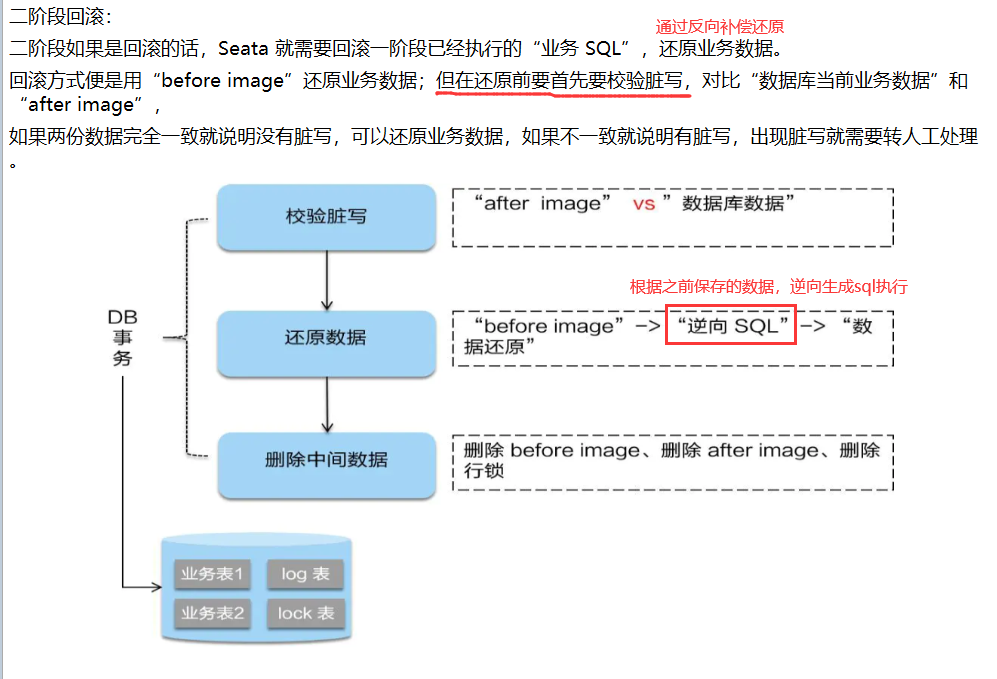

5.2.3 二阶段回滚

二阶段如果是回滚的话,Seata 就需要回滚一阶段已经执行的“业务 SQL”,还原业务数据。

回滚方式便是用“before image”还原业务数据;但在还原前要首先要校验脏写,对比“数据库当前业务数据”和 “after image”。如果两份数据完全一致就说明没有脏写,可以还原业务数据,如果不一致就说明有脏写,出现脏写就需要转人工处理。

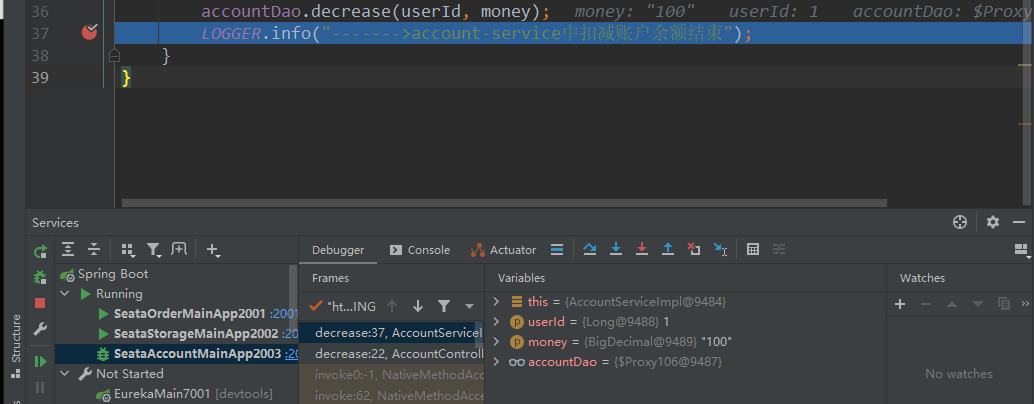

5.3 debug查看流程

最开是seata库中的三张表是没有数据的

2003打上断点,debug启动

访问http://localhost:2001/order/create?userId=1&productId=1&count=10&money=100。

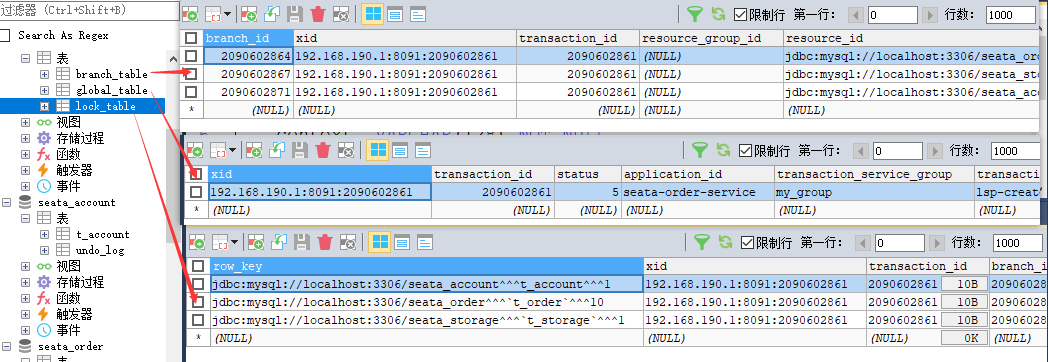

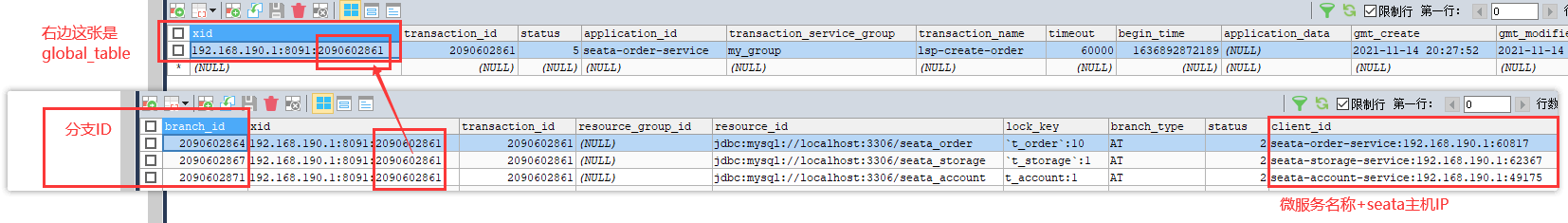

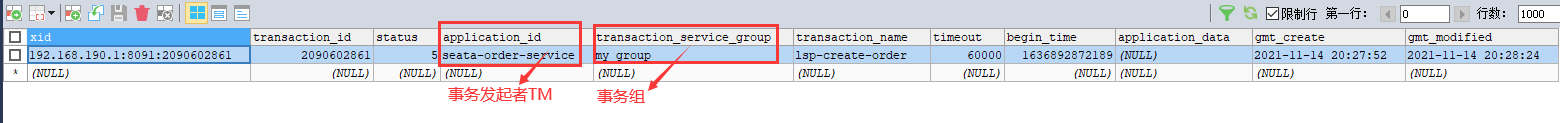

此时seata库中的三个表都是有数据的:

看一下branch_table,记录了各个RM的信息,分别对应order、storage、account三个微服务

可以看到xid跟global_table中的xid一致。

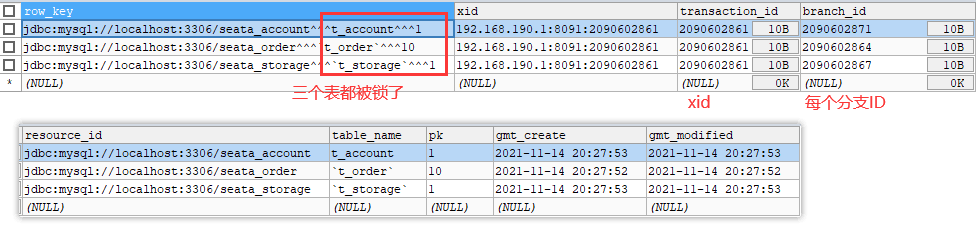

查看lock_table:

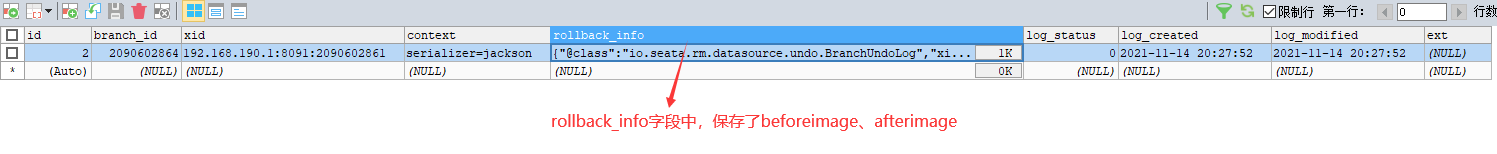

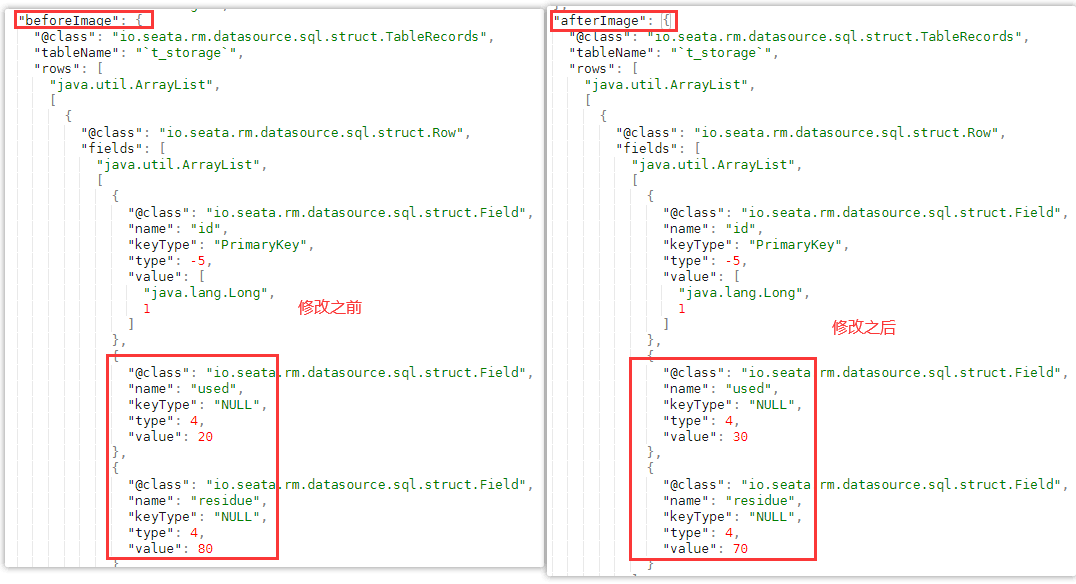

查看各业务中的undo_log表:

rollback_info是JSON字符串,存储了beforeimage,afterimage:

{

"@class": "io.seata.rm.datasource.undo.BranchUndoLog",

"xid": "192.168.190.1:8091:2090602861",

"branchId": 2090602864,

"sqlUndoLogs": [

"java.util.ArrayList",

[

{

"@class": "io.seata.rm.datasource.undo.SQLUndoLog",

"sqlType": "INSERT",

"tableName": "`t_order`",

"beforeImage": {

"@class": "io.seata.rm.datasource.sql.struct.TableRecords$EmptyTableRecords",

"tableName": "`t_order`",

"rows": [

"java.util.ArrayList",

[]

]

},

"afterImage": {

"@class": "io.seata.rm.datasource.sql.struct.TableRecords",

"tableName": "`t_order`",

"rows": [

"java.util.ArrayList",

[

{

"@class": "io.seata.rm.datasource.sql.struct.Row",

"fields": [

"java.util.ArrayList",

[

{

"@class": "io.seata.rm.datasource.sql.struct.Field",

"name": "id",

"keyType": "PrimaryKey",

"type": -5,

"value": [

"java.lang.Long",

10

]

},

{

"@class": "io.seata.rm.datasource.sql.struct.Field",

"name": "user_id",

"keyType": "NULL",

"type": -5,

"value": [

"java.lang.Long",

1

]

},

{

"@class": "io.seata.rm.datasource.sql.struct.Field",

"name": "product_id",

"keyType": "NULL",

"type": -5,

"value": [

"java.lang.Long",

1

]

},

{

"@class": "io.seata.rm.datasource.sql.struct.Field",

"name": "count",

"keyType": "NULL",

"type": 4,

"value": 10

},

{

"@class": "io.seata.rm.datasource.sql.struct.Field",

"name": "money",

"keyType": "NULL",

"type": 3,

"value": [

"java.math.BigDecimal",

100

]

},

{

"@class": "io.seata.rm.datasource.sql.struct.Field",

"name": "status",

"keyType": "NULL",

"type": 4,

"value": 0

}

]

]

}

]

]

}

}

]

]

}

查看seata_storage库中的undo_log表的roobal_info信息,可以看到beforeimage和afterimage分别保存了修改前后的信息。

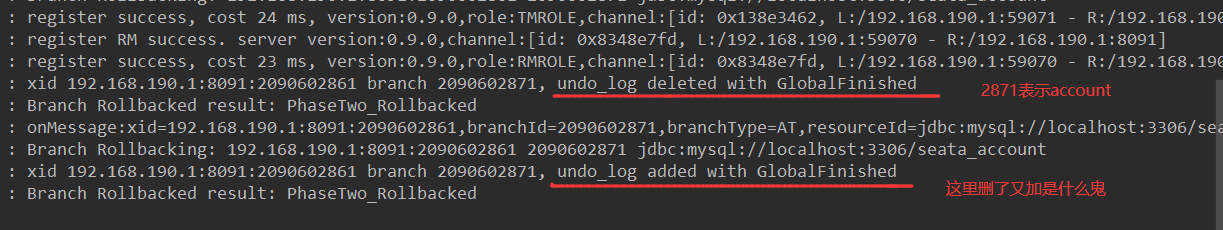

debug放行,seata库中表中的中间数据和undo_log表的数据都删除了。(我的seata_account表的undo_log中没有被删除,等了半天也没有。)异步任务阶段的分支提交请求将异步和批量地删除相应的undo_log记录。

发现account2003微服务的日志跟2001和2002都不一样

5.4整体流程图

2175

2175

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?